« À l’ère numérique, même les chatbots se gardent bien de causer politique au risque de dérapages électoraux ! » – Voilà le ton de notre épopée technologique du jour. Alors que les élections présidentielles de 2024 aux États-Unis se profilent, Anthropic, la belle endormie startup de l’IA qui ne lésine pas sur les moyens, teste une technologie baptisée Prompt Shield. Son mantra ? Détecter quand les internautes chuchotent des mots doux sur les sujets politiques à son chatbot GenAI pour habillement les rediriger vers des sources plus, comment dire, « autorisées » en matière d’information électorale.

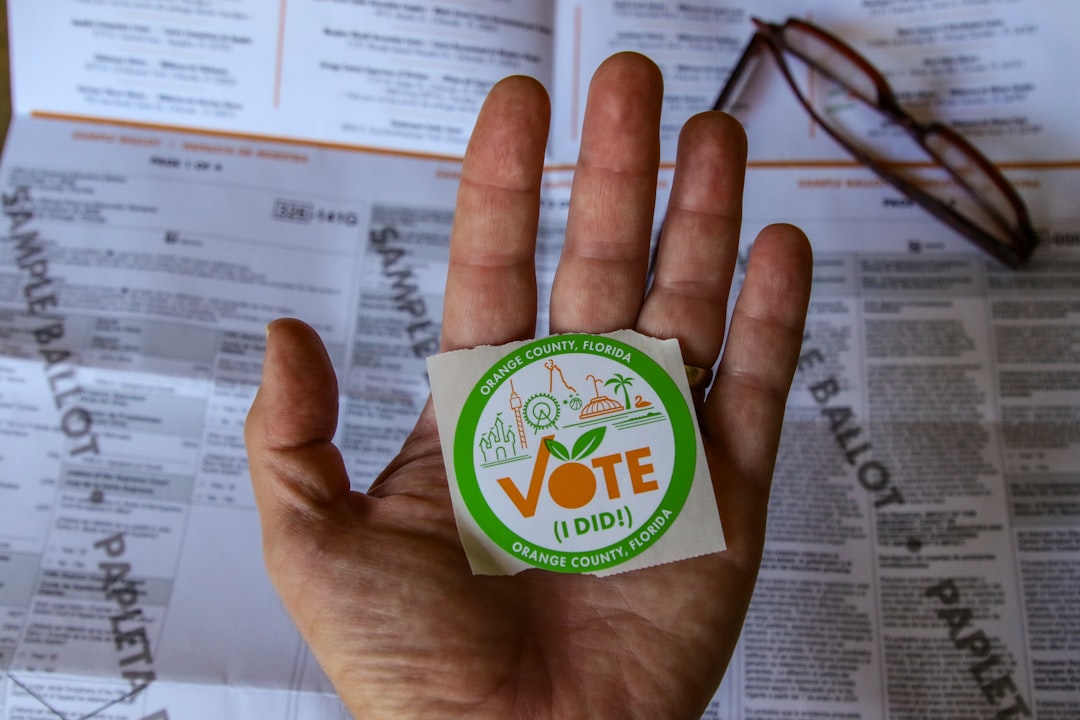

Et comme dans un bon western technologique, notre shérif Prompt Shield, armé d’une IA perspicace et de règles pointues, bondit sur l’affichage d’une fenêtre contextuelle dès qu’un utilisateur américain de Claude, la version linguistique de l’androïde numérique d’Anthropic, murmure une question sur le vote. C’est alors la redirection vers TurboVote, une ressource non partisane de l’organisation Democracy Works, où foisonnent les infos précises et actualisées sur le vote.

La nécessité est mère d’invention, dit l’adage, et chez Anthropic on reconnaît sans ambages que Claude a comme qui dirait quelques lacunes en matière d’informations politico-électorales. Sa formation n’est pas assez récurrente pour fournir des données en temps réel sur des élections spécifiques, ce qui le pousse à l’hallucination – ou si vous préférez, à inventer des faits – concernant ces mêmes élections.

Dans l’arène politique, même les IA ont besoin de guides pour ne pas s’aventurer en terres inconnues.

Pourtant, ne vous y méprenez pas, nos amis d’Anthropic vous diront que le « prompt shield » n’est pas né de la dernière pluie numérique. Il veille au grain dès la création de Claude, en érigeant un barrage contre divers types de méfaits, toujours en acier trempé avec leur politique d’utilisation acceptable. Et ce n’est qu’une question de semaines avant que leur intervention spécifique à l’élection ne soit déployée grandeur nature. Les concertations ont été nombreuses, avec des parties prenantes aussi variées que des décideurs, des entreprises collègues, des organisations civiles, des agences non gouvernementales et même des consultants spécialisés en élection. Pour l’heure, ce système n’en est qu’à ses balbutiements. Claude a malicieusement omis de me présenter la fameuse pop-up lors de ma demande d’informations pour voter à l’élection imminente, se contentant plutôt de recracher un guide de vote générique. Mais ne nous y trompons pas, Anthropic peaufine son bouclier tandis qu’il se prépare à élargir sa garde à un plus grand nombre d’utilisateurs.

En adoptant une posture plus chevaleresque que belliqueuse, Anthropic interdit l’utilisation de ses outils de génie numérique dans les campagnes politiques et le lobbying. Mais n’allez pas croire que c’est une exception dans la cuvée GenAI : d’autres fabricants de ces prodiges numériques mettent en place des politiques et des technologies pour s’efforcer de prévenir toute interférence électorale.

La prophétie de l’élection mondiale semble se concrétiser cette année : plus d’électeurs que jamais auparavant dans l’histoire sont attendus aux urnes, puisque pas moins de 64 pays d’une population combinée avoisinant les 49% de la population mondiale s’apprêtent à tenir des élections nationales. Pendant ce temps, nos camarades de jeu d’OpenAI bannissent l’utilisation de ChatGPT, leur starlette chatbot AI, pour créer des bots qui personnifient de vrais candidats ou gouvernements, travestissent le fonctionnement du vote ou découragent carrément de voter. Suivant la doctrine d’Anthropic, OpenAI ne permet pas non plus à ses utilisateurs de mijoter des applis à des fins de campagnes politiques ou de lobbying – un véto qu’ils ont réitéré le mois dernier.

Aux États-Unis, le Congrès tardant à faire adopter une législation pour réguler le rôle de l’industrie de l’IA dans le secteur politique, ce malgré un soutien bipartite, certains États ont pris les devants en passant ou en introduisant des projets de loi pour adresser la question des deepfakes dans les campagnes politiques alors que la législation fédérale stagne. Et, galamment, des plateformes – sous la pression de chiens de garde et de régulateurs – prennent des mesures pour empêcher ces joyaux de l’IA d’être détournés à des fins d’égarement ou de manipulation des électeurs.

Google, jouant le rôle de bonne fée numérique, a déclaré en septembre dernier qu’il exigerait que les annonces politiques utilisant GenAI sur YouTube et sur ses autres plateformes, tels que Google Search, soient assorties d’une divulgation proéminente si les images ou les sons étaient synthétiquement altérés. Meta, non plus n’est pas en reste, et a également interdit l’utilisation d’outils GenAI – y compris les siens – dans la publicité à travers ses domaines.

Source : Techcrunch