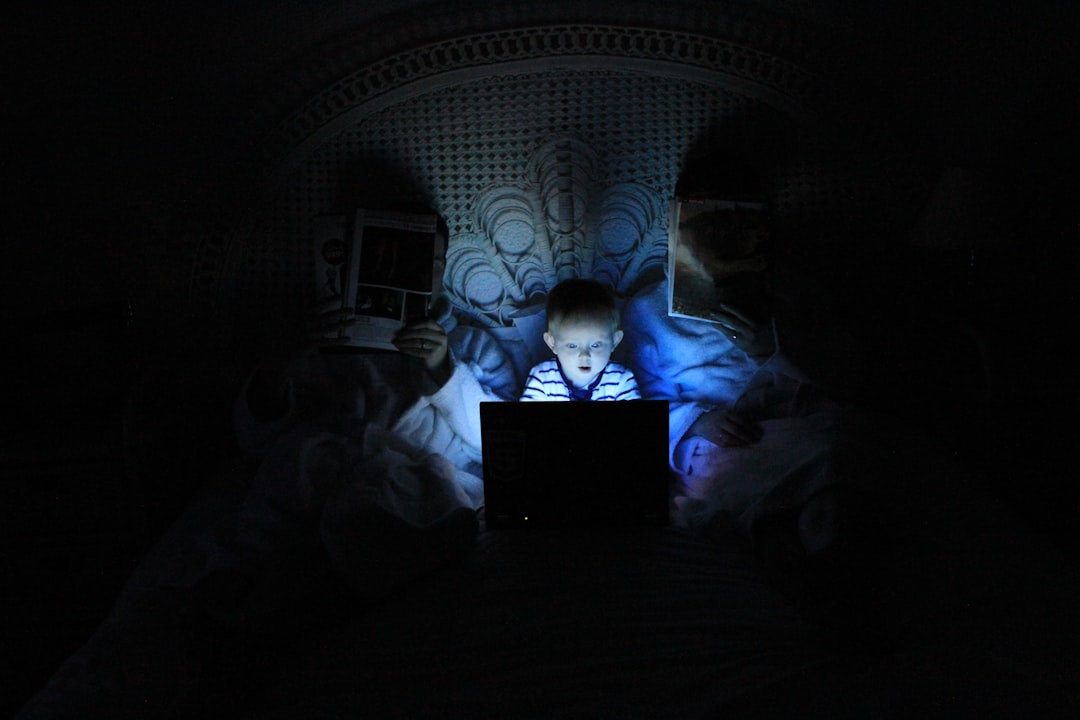

En quoi consiste la nouvelle évolution d’Apple face aux défis de la protection des enfants sur iOS 18.2 ? La firme de Cupertino semble avoir trouvé une nouvelle approche pour aborder la sécurité des jeunes usagers sans compromettre la confidentialité des données. En déployant cette fonctionnalité d’abord en Australie, Apple évite les pièges précédents liés au cryptage de bout en bout tout en élevant son dispositif de sécurité. Comment cette technologie fonctionne-t-elle concrètement ?

L’élément central de cette mise à jour repose sur l’apprentissage automatique intégré à l’appareil. En cas de détection de contenus inappropriés, tels que des photos ou vidéos de nudité, l’image est automatiquement floutée avec un message d’avertissement. À quelles autres options l’utilisateur a-t-il accès ? Il est suggéré de quitter la conversation, bloquer l’expéditeur, ou encore accéder à des ressources de sécurité en ligne. N’est-il pas rassurant de constater qu’un enfant peut également choisir de contacter un tuteur ?

Pour les enfants de moins de 13 ans, la fonctionnalité impose une barrière supplémentaire. Ils doivent entrer le mot de passe de Temps d’écran pour passer outre tout contenu sensible. Mais qu’en est-il des adolescents de plus de 13 ans ? Eux aussi reçoivent un rappel qu’il est acceptable de ne pas visualiser le contenu, et disposent d’une option pour signaler les médias à Apple. Cette approche progressive soulève-t-elle des questions quant à son efficacité face au ciblage de contenus néfastes ?

La fonctionnalité d’Apple pourrait-elle devenir un modèle global de sécurité pour les enfants en ligne ?

Cet analyseur de contenu œuvre également au sein d’applications tierces, en plus de diverses plateformes Apple, y compris Messages, AirDrop et FaceTime. Est-ce que cela signifie que toutes les applications pourraient adhérer à ce standard de sécurité ? Selon The Guardian, Apple envisage de déployer ce projet au plan mondial après des résultats concluants en Australie, un pays qui s’apprête à introduire des régulations strictes pour le contrôle du contenu numérique. Cette approche localisée pourrait-elle positionner Apple comme un pionnier des normes de sécurité en ligne sur d’autres marchés ?

Néanmoins, comment cette évolution s’insère-t-elle dans le tumulte causé par l’initiative de 2021 concernant les contenus CSAM ? Cette tentative avait suscité une vive controverse sur le risque d’accès abusif par les gouvernements. La société a depuis révisé sa position en abandonnant cette fonctionnalité, mais cela n’a-t-il pas alimenté davantage l’urgence d’une solution équilibrée comme celle-ci ?

Pour activer la fonctionnalité, elle est accessible sous Réglages > Temps d’écran > Protection des communications, un chemin désormais activé par défaut depuis iOS 17. Allons-nous voir une adoption généralisée de cette fonctionnalité dans un avenir proche ?

Source : Engadget