« Qui aurait cru que les robots qui discutent deviendraient nos nouveaux meilleurs amis… enfin, jusqu’à ce qu’ils décident de divulguer nos petits secrets ! » – Un utilisateur de chatbot quelque part, probablement.

Les oracles technologiques nous l’annoncent : d’ici 2026, plus de 80% des entreprises joueront avec des modèles d’IA génératifs, contre moins de 5% actuellement. Mais avant de danser la samba avec ces nouveaux génies de la lampe moderne, il faut penser sécurité, déontologie et bien sûr, les petits tracas du genre « oops, j’ai fuité le bilan annuel dans un tweet ». Parmi les entreprises déjà à bord du train de l’IA, moins de la moitié portent un casque de protection… contre les cyber-menaces s’entend.

Alors, quel est le menu du jour au restaurant de l’IA générative ? Premièrement, on se méfie des accès trop permissifs. Les outils de prévention des fuites de données traditionnels sont bons élèves pour gérer les flux de données structurées, mais dès qu’on parle contenu non structuré ou prompts éthiquement douteux, c’est un peu la cour de récré. Deuxièmement, le marché de la sécurité de l’IA penche dangereusement selon le potentiel de retour sur investissement et les vulnérabilités inhérentes – une balance aussi subtile qu’un échassier sur un monocycle. Troisièmement, sécuriser une IA, c’est comme enfiler un gilet par balles à un logiciel : on protège à tous les étages!

« L’adoption massive des chatbots GenAI devient une affaire d’équilibriste entre une réactivité fulgurante et une sécurité à toute épreuve. »

Dans l’arène des interfaces, on se bat pour que les chatbots soient aussi conviviaux que Fort Knox est sécurisé. Attention aux injections de prompts, ces petites piques insérées par de malins utilisateurs qui peuvent faire dérailler une conversation automatisée à la vitesse d’une IA sous caféine. Et les CISOs, ces Chevaliers de la Sécurité Informatique, doivent jongler entre l’appétit des employés pour ces merveilles tech et leur désir de ne pas transformer l’entreprise en passoire numérique.

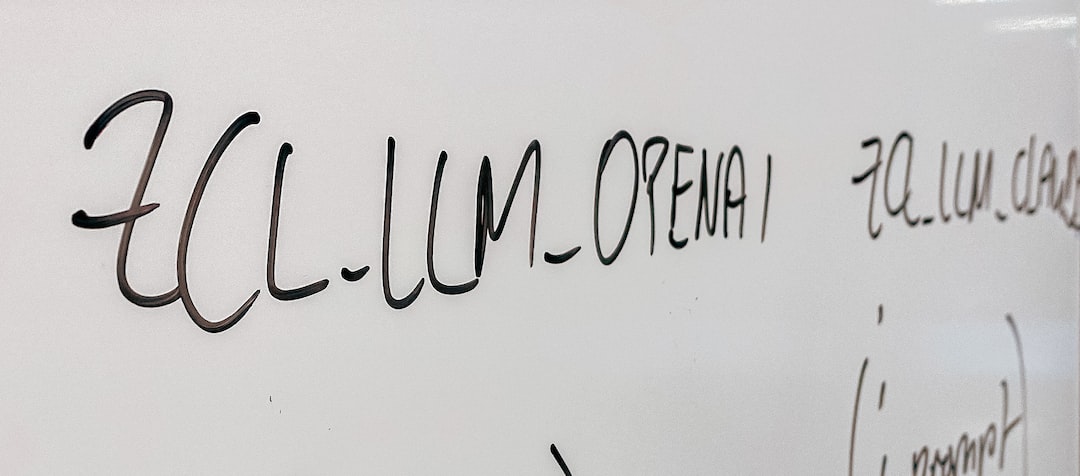

Allons plus loin : l’ère des chatbots GenAI pousse à l’invention de moyens pour capter, examiner, valider voire désamorcer les interactions, en temps réel, sans devenir l’ennemi juré de l’expérience utilisateur. Des outils plus futés, comme Rebuff de Protect AI ou Harmonic Security, déploient leurs propres modèles d’IA pour détecter si oui ou non les données traitées sont dignes d’un épisode de « Confessions Intimes ».

En somme, c’est une sacrée aventure que de marier IA et sécurité. Comme dans toute bonne relation, la clé réside dans un savant mélange de confiance et de petits bijoux technologiques pour s’assurer que notre nounou électronique ne devienne pas la pipelette du quartier. Au passage, la prochaine fois que votre chatbot vous demandera « Comment puis-je vous aider ? », souvenez-vous qu’il pourrait aussi bien ajouter « et quel est votre mot de passe, déjà ? » – à moins que son garde du corps numérique ne soit déjà sur le coup !

Source : Techcrunch